『統計学を哲学する』(大塚淳 著)は2020年のベスト3に入る一冊になりそうです。僕の知的好奇心のツボにはまりました。スキマ時間を使って年に100冊くらい乱読(?)していますが、この本は印象に残ります。すでに大手書店やアマゾンでは入手が難しくなっているようですが、幸い僕は発売前から予約していたのでよかった。

ちなみに、この本を読んだからといって現世的な御利益はあまり期待できないでしょう。読んで得た知識によって統計プログラミングが上手くなるわけでもなし、論文数が増えるわけでもなし、ラボミーティングで洒落た発言ができるようになるわけでもなく(当ラボではこういう根本的な見方は大歓迎ですけど)、カクテルパーティーで話題の中心になれそうにもありません(むしろ孤独を楽しめそうです)。

僕が感銘を受けたのは、我々が統計学を勉強・使用するなかで言語化しないで扱ってしまっている抽象的な存在論的前提、意味付け、正当化(つまり空気のように扱っているもの)を論理と哲学的ツール道具立てにより結晶化していること。それは統計学の深い理解・知恵につながります(注1)。

そして科学の営みとは一体何なのかという(答えは一つではない)根本的命題に正面から向き合っていることでしょうか。この命題(および統計学がいかにしてその根拠になるのか)が本書で繰り返し登場しています。それは僕にとっては多分に「真理に一歩でも近づく」ということです。一方でインパクトはあくまで結果産物です(10年後の未来を規定するインパクトを出している自負あり)。しかしながら、ここHarvardの臨床系・公衆衛生系「研究者」(とくにヘルスサービスあたり。ただし実学だからか?)が真理 ”truths”ということを議題にすることは滅多にありません(僕のメンターには注意されたことがある 注2)。彼ら/彼女らは(存在として仮定された)真理の存在を前提とする統計的推論を使いながらも、その真理の存在をほぼ無視し、むしろ”インパクト”(およびグラントを取るといった世俗的なachievement)ありきです。昨今の日本もそれを追随しているように見えます。

とはいっても、著者は必ずしも真理に近づくことを目的としない予測という統計学の一つのゴールにもそれなりの認識論的意味づけを与えています。前ブログ記事で紹介したEfronの論文でも、random forestやboosting (およびdeep learning [GANは面白い例外])といった機械学習アルゴリズムは実際に真なる分布(すなわち仮定された「真理」のapproximationとして確率分布)に到達する保証も数理的正当づけも(現時点では)ありません。知識は正しさだけでなく正当化プロセスも要請するはずですが、このような機械学習アルゴリズムの予測はどうようにしてそのプロセスを正当化するのでしょうか。そこで提示されるのが、プラグマティズム的に「タスクにおいて予測性能がよければそれでオッケー」という正当性です。そこでは「正しいかどうかは副次的な問い」であり、真なる分布みたいなものはゴールではなく「良い予測や制御を導くための道具的な仮定」にすぎないという(エンジニアリング的な)位置づけです。このような場合には真理に近づくよりも、汎化性能のほうが大事なはずです。近年のAIブームはこのプラグマティズム的正当化に(やや盲目的な)拍車をかけていますが、今後はEfronのような統計学者との綱引きや合流点を探る営みが大事になるように僕は思います。

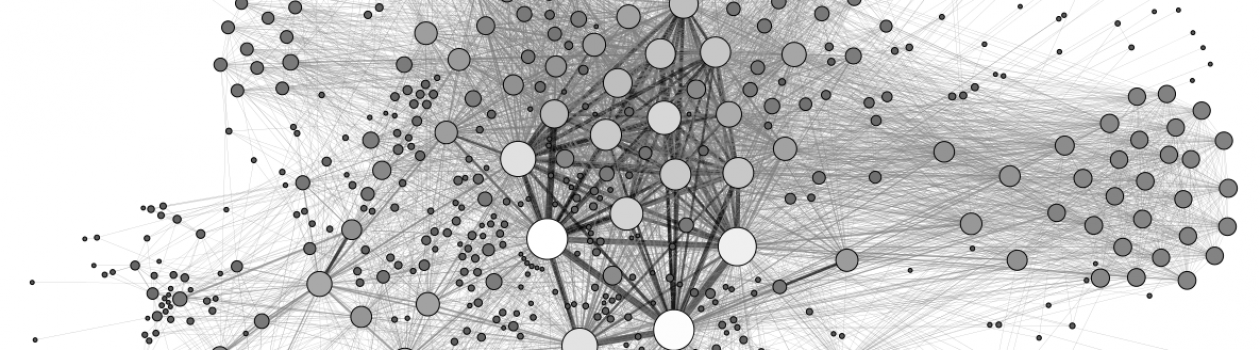

他にも統計的因果推論にも面白い考察がなされています。Judea Pearlも3つの”the Causal Hierarchy”(association→ intervention→ counterfactualsの順に深くなる)という階層およびそれぞれに必要な道具(例えばthe do-calculus)を紹介しています(Pearl. arXive 2018; 注3)。この著作ではさらに存在論的な道具立て(データ+確率モデル+因果モデルの「三元構造」)をさらにわかりやすく導入しています。そして「介入とは現実世界から可能世界への写像なのであって、因果推論とは畢竟、そのマッピングの法則性を突き止めることにほかならない」というまとめには目から鱗でした(注4)。さらには、ハーバード疫学学派では全く話題にされない(むしろ触れてはいけないタブーなんでしょう; 注5)因果探索についても軽く触れています(これは僕の今年のトピックの一つ)(注6)。そして、いまだに答えの出ていない因果命題の哲学的意味づけ(そもそも「XがYの原因である」とはどういうことなのか)にはPearlのSCMやRubin’s potential outcome frameworkをおさらい的に紹介しています。一方で認識論的考察はあまりなされていないのですが、続編(?)に期待しています。

他にも単に知識として勉強になったことがありました:例えば、赤池情報基準 (AIC)がKL-divergence の平均の推定量だったなんて。。。きっと数理統計をやる人には常識なんでしょうけどね。勉強不足でした。

この本が(一部の層にとって?)ここまで話題になることは著者および出版社にとっても驚きだったようです。なんせ「統計学」+「哲学」の組み合わせです。もしこの本がアメリカで出版されたとしても(可能世界の一つ)、ここまで売れることはまずなかったでしょう (潜在結果)。ここアメリカはよく言えば実践的で行動的(悪く言えば世俗的で軽薄)なお国柄。逆に日本で話題になったのは、著者の目的とした「データ解析に関わる人にちょっとだけ哲学者になり。。。」というプチ哲学書的な位置づけが成功したからかもしれません。

読者を選ぶ一冊だと思いますが、とても面白かったです。

注釈

注1:深いところの理解があるとcategorical errors (数学だったら部分点さえもらえないような間違い)は防げます。論文でありがちなのはinclusion/exclusion criteriaのセクションを”population”としてしまう(”sample”ではなく)、リスク因子を探す研究目的なのに多変量解析をした途端に”confouding”の概念を導入ししまう、あたりでしょうか。

注2: 駆け出しの頃論文で軽々しく “in fact”という英語を使ってメンターののCarlosに注意された。Scientistにとっての”fact”という言葉の重みを教えてもらって、今でも感謝しています。

注3:Pearl J. Theoretical impediments to machine learning with seven sparks from the causal revolution. arXive 2018。一般書であれば Judea Pearl著の”The Book of Why”に詳しく載っています。

注4:ここはPearl流の因果推論の基礎があったほうが納得するのかも。入門書としては『構造的因果モデルの基礎』(黒木学著)でしょうか。

注5:Causal DAGを描くことが不能ならば(因果構造がそもそも自明でないとしても)、その後のg-methodsといった手法が有効に使えないですよね。

注6:日本人が先鋭的な研究をしてます。たとえば『統計的因果探索』(清水昌平著)はおすすめです。

読んでいて思わず唸ってしまいました。さすがの慧眼、感服いたしました。長谷川先生は根っからのサイエンティストなのだな、と。

赤池情報量基準については、KL情報量からの導出、最後にシンプルな数式に帰結する過程は非常にエキサイティングなものです。まさにアインシュタインの警句、 “Everything should be made as simple as possible, but not simpler.” そのもので非常に美しく感じました。

宜保先生、コメントありがとうございます!

とても恐縮です。

僕にはとてもKL-divergenceからの導出やその美しさがわかるレベルに達しないでしょうけど(悲しい)、楽しく勉強しています。

今後もいろいろと御教授ください。